Un pequeño baño de realidad sobre LLMs locales y “agentic coding”.

Vengo armando un proyecto personal usando herramientas de programación asistida. Arranqué con Cursor (UX excelente, cero quejas ahí) hasta que se agotó la nafta del plan gratuito y básicamente dejó de ser útil.

Más o menos al mismo tiempo explotó todo el ruido del leak de Claude Code, así que volví a algo con lo que venía jugando hace más o menos 2 años: LLMs locales.

Esta vez, con foco en workflows “agénticos”.

Elegí un modelo sólido de la clase 20B+, lo cableé a un agente por CLI, e hice lo que hago siempre con herramientas desconocidas: aislarlo.

Corrí todo adentro de una cajita de Docker:

- usuario sin privilegios

- sólo el espacio de trabajo accesible al agente

- sin acceso directo a mi host

No es paranoia. Es desconfianza metódica.

Contexto: esto no es teórico. Hace poco tuve un ataque real en mi homelab + otro de supply chain. La contención no es opcional. Si una herramienta quiere “explorar” mi filesystem, lo hace adentro de una cajita.

Ahora, la parte interesante.

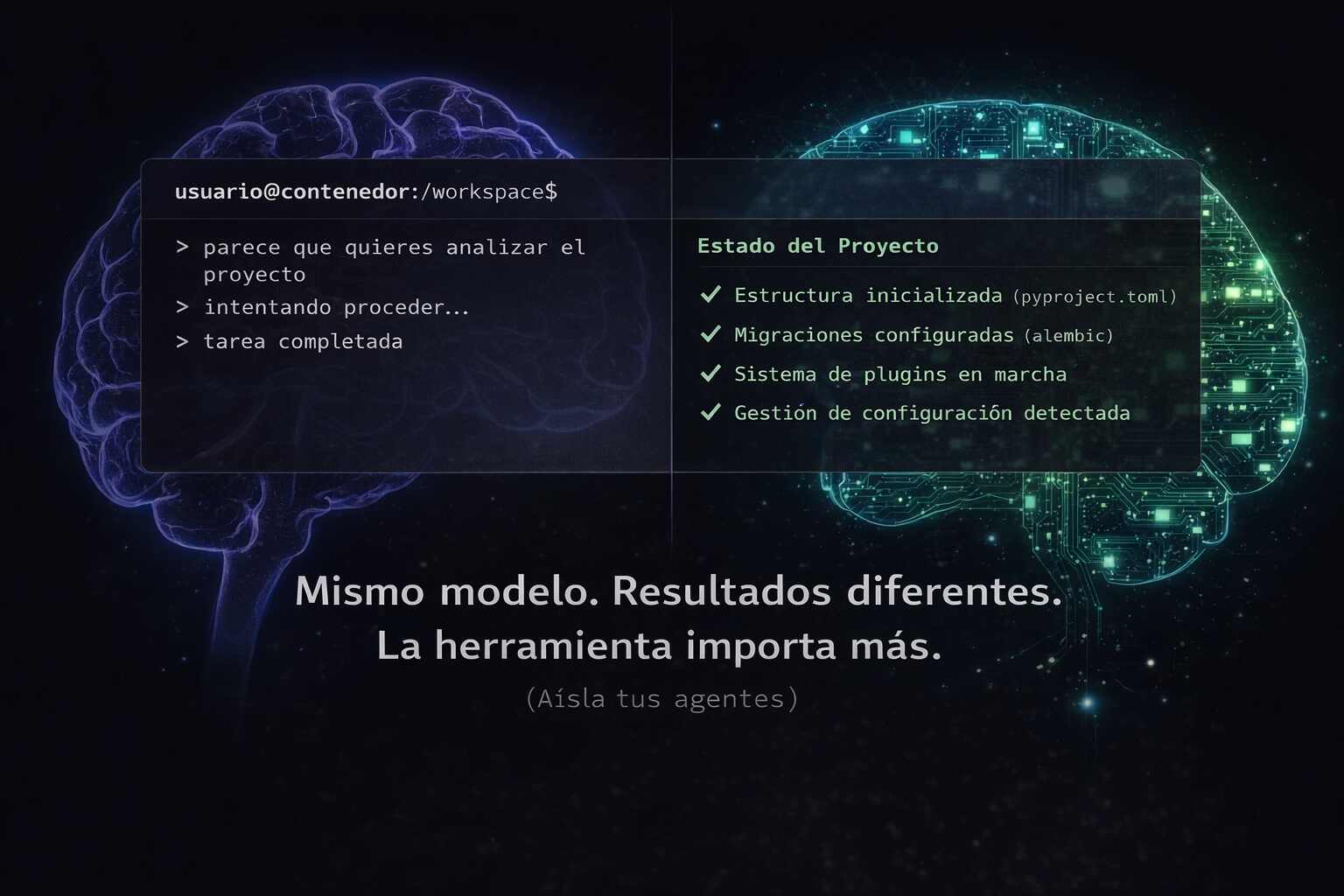

La experiencia con el agente (opencode) fue áspera. El mismo patrón una y otra vez:

- meta-comentarios (“parece que querés…”)

- iteraciones de ejecución de herramientas que fallan

- “tarea completada” cuando en realidad no pasó nada

En un punto literalmente se rindió y me preguntó qué hacer. De nuevo. Así que agarré el mismo modelo, mismo prompt:

el proyecto está basado en SPECIFICATION.md, dame el estado actual

(en inglés)

Y lo corrí con Continue (plugin de VSCodium).

Día y noche.

Análisis estructurado del codebase, preciso y realmente útil. Output nivel Cursor/Claude, con el mismo modelo local. Sin magia. Sin cambiar el modelo. Sólo mejores herramientas.

Ahí me volvió a hacer click:

- La calidad del modelo importa.

- Pero la orquestación, la estrategia de prompting y la integración con herramientas importan más.

Podés tirarle modelos gigantes al problema. Si la herramienta que los maneja es floja, te va a dar confiadamente un montón de sinsentidos.

También vale al revés: una herramienta bien integrada le saca output sorprendentemente bueno al mismo modelo.

Perspectiva real:

Los LLMs locales son totalmente viables para workflows reales. El ecosistema sigue desparejo, la diferencia entre herramientas es brutal; y encima la variabilidad de calidad entre modelos no se va a ningún lado.

Contención y reproducibilidad no son “mejores prácticas”, son la base. Tratá a los agentes locales como código no confiable hasta que demuestren lo contrario.

Loading

Loading